深度求索推出的DeepSeek,是一款功能強大的AI大模型,在25年1月11日上線。DeepSeek - R1的性能對標OpenAI o1正式版,其手機版應用曾一度登上美區App Store單日下載量榜首,這對ChatGPT的統治地位以及世界AI格局都造成了較大沖擊,使得DeepSeek更多地出現在大眾視野里。

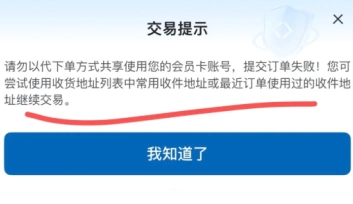

然而,因DeepSeek頻繁遭遇網絡攻擊,且訪問量過高,用戶在與DeepSeek對話時,常常會出現“服務器繁忙,請稍后再試。”的提示,這著實讓不少朋友感到困擾。那么,有沒有什么好辦法能解決這種狀況呢?

確實存在解決辦法,即用戶在本地部署DeepSeek大模型。然而,這種方式對電腦配置要求較高,普通用戶大多只能在本地部署 “殘血版” 的DeepSeek模型,其使用體驗比不上官網的 “滿血版”。不過,要是你對使用要求不高,對信息時效性也沒有特別嚴格的要求,那勉強也能使用。接下來言歸正傳,為大家分享DeepSeek本地部署的保姆級教程。

①本地安裝Ollama

在此給大家說明一下,Ollama是一款開源框架,借助它,你能夠在本地運行大模型,其他方面無需過多關注,了解這一點便足矣。

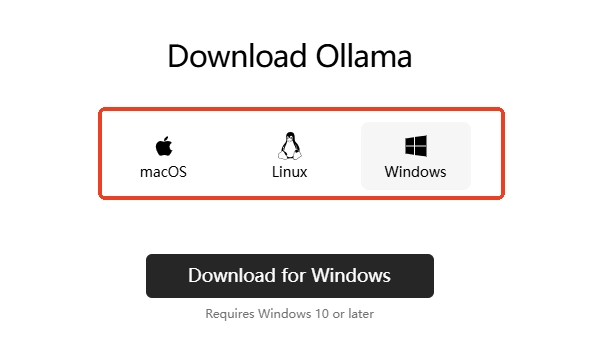

進入Ollama官網,選擇合適的版本下載即可。

官網:https://ollama.com/

根據你的系統選擇您需要下載的Ollama版本。

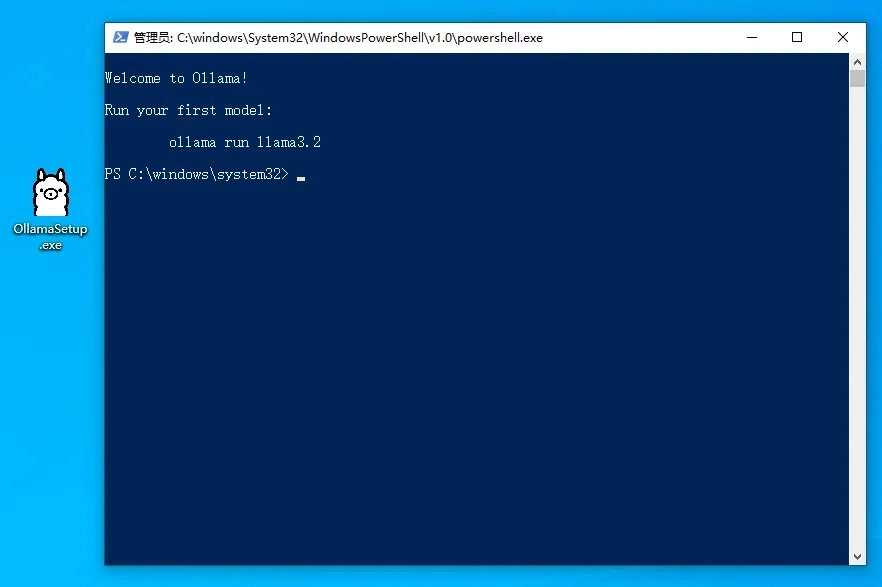

下載完成后點擊安裝,安裝成功后會彈出一個命令行界面。Ollama本身不存在可視化界面,不過這并不妨礙后續使用,畢竟它僅僅是一個框架。

完成上述步驟后,基礎就打好了。

②下載DeepSeek-R1模型

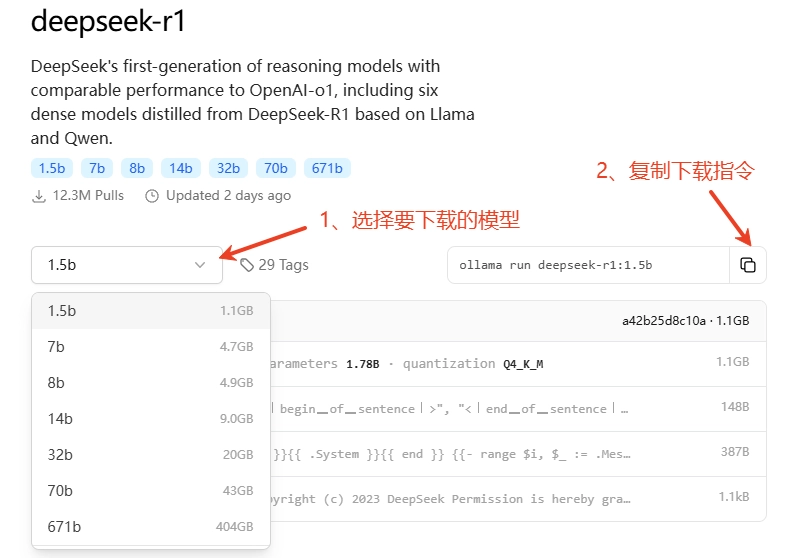

訪問下方鏈接,選擇要下載的模型,并在右側復制對應的命令,這里以最小的1.5b版本作為演示。

https://ollama.com/library/deepseek-r1

選擇好您要下載的模型,并復制下載的指令。

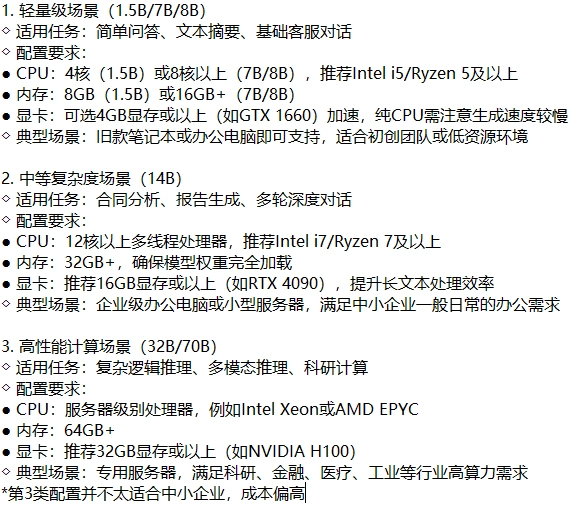

DeepSeek-R1模型相關參考標準如下:

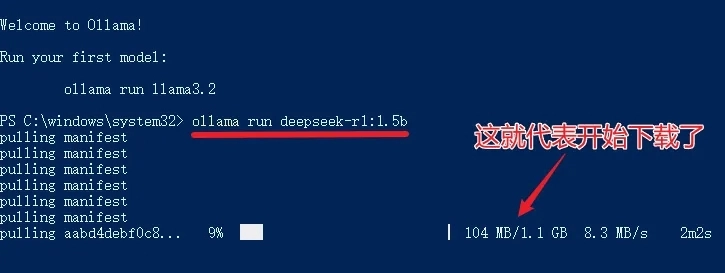

以1.5b版本為例,復制命令后粘貼到命令行中運行即可下載,速度取決于你的網速。

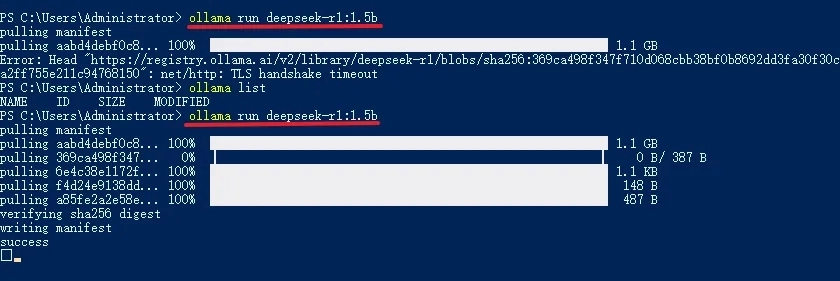

如果下載完成后報錯,就再運行一遍下載命令,提示“success”就代表下載完成了。

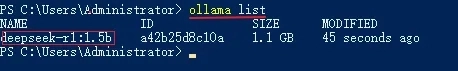

然后在命令行里輸入“ollama list”來查看下載成功的模型,下圖這種情況就代表一切準備就緒了。

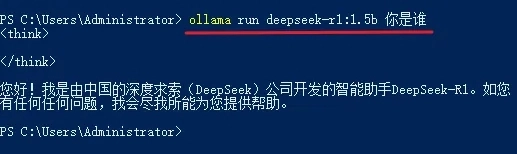

接下來,在命令行中輸入「ollama run deepseek-r1:1.5b + 問題」,就能開啟AI對話。要是你下載的是7b模型,那就輸入「ollama run deepseek-r1:7b + 問題」,依此類推。

很明顯,單純依靠命令行進行對話,體驗著實欠佳。因此,我們需要借助一款第三方AI客戶端來調用本地模型,以此提升整體體驗。

③通過Cherry Studio調用模型

官網(Win+Mac+Linux):

https://cherry-ai.com/

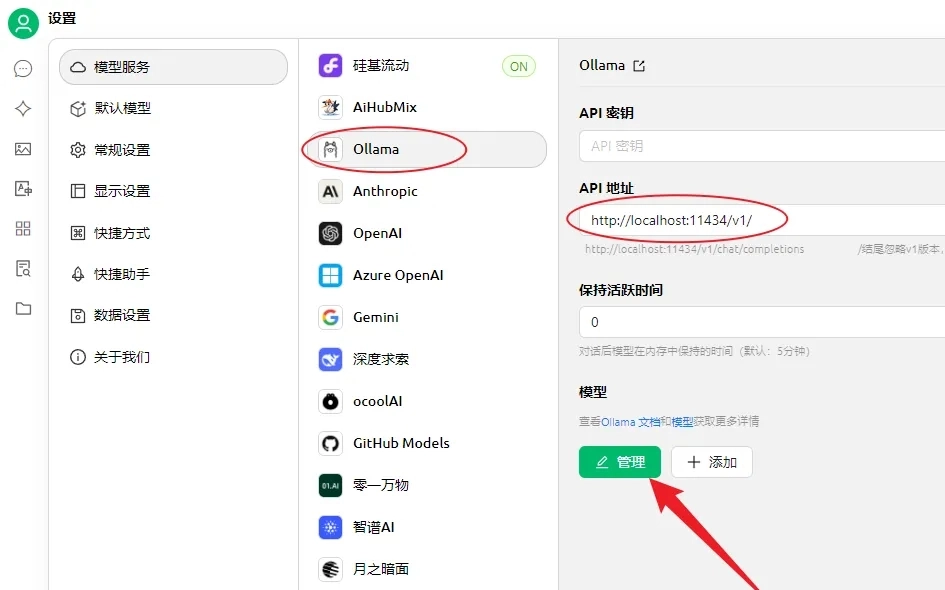

下載完成后,打開客戶端,進入設置界面,在其中選擇「Ollama」,此時 API 地址會自動填充,務必保證該地址與下圖所示地址完全一致,完成上述操作后,點擊“管理”按鈕。

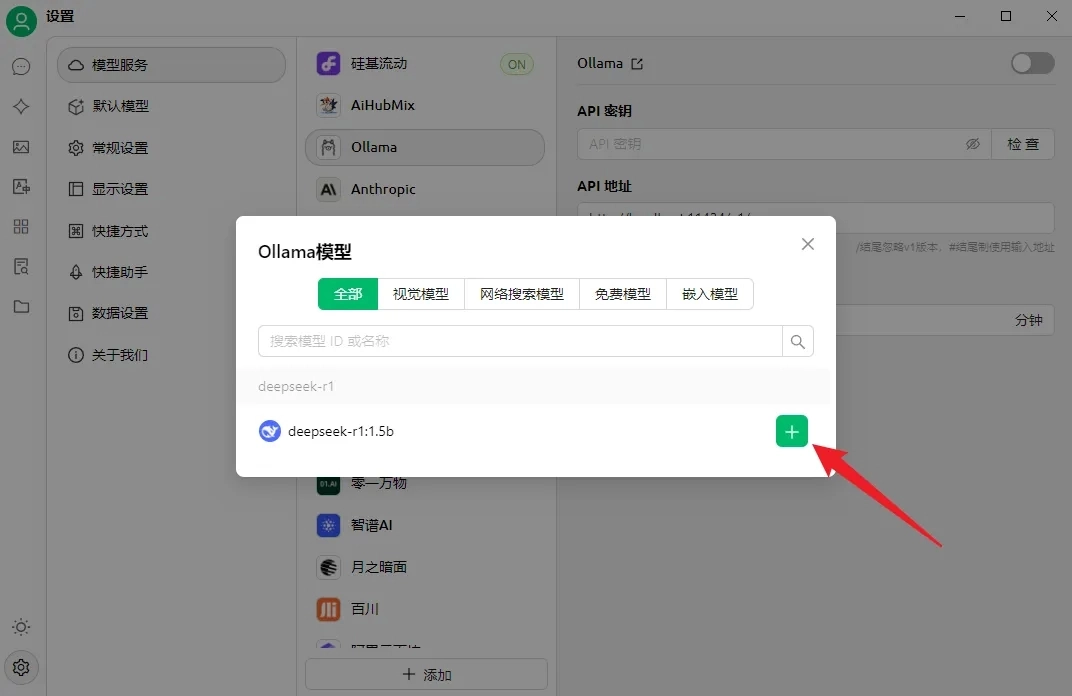

在彈出的窗口中可以看到自己本地的模型,點擊右側的按鈕添加模型即可。

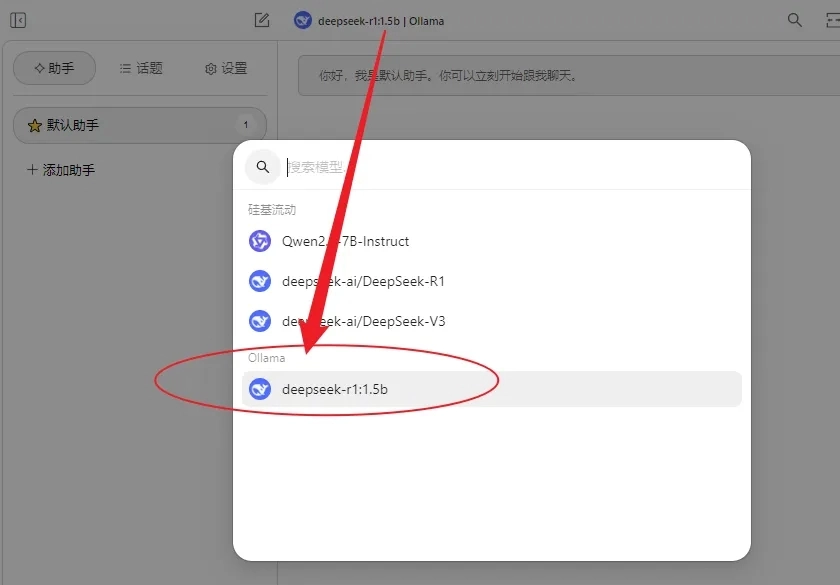

最后進入對話頁面,點擊頂部模型名稱切換成本地部署的模型,至此大功告成。

以上便是3322軟件站為各位分享的借助Ollama達成DeepSeek本地部署的保姆級教程的所有內容,期望能給您帶來幫助!

相關文章

更多

2025-11-10 14:55:04

2025-12-02 10:41:03

2025-12-02 11:14:03

2025-12-02 13:19:04

2025-12-02 14:22:04

2025-12-02 14:24:04